최근 음성 인식 기술이 정말 빠르게 발전하고 있다는 걸 체감하는 요즘인데, 마이크로소프트가 또 하나 재미있는 걸 오픈소스로 공개했다고 한다.

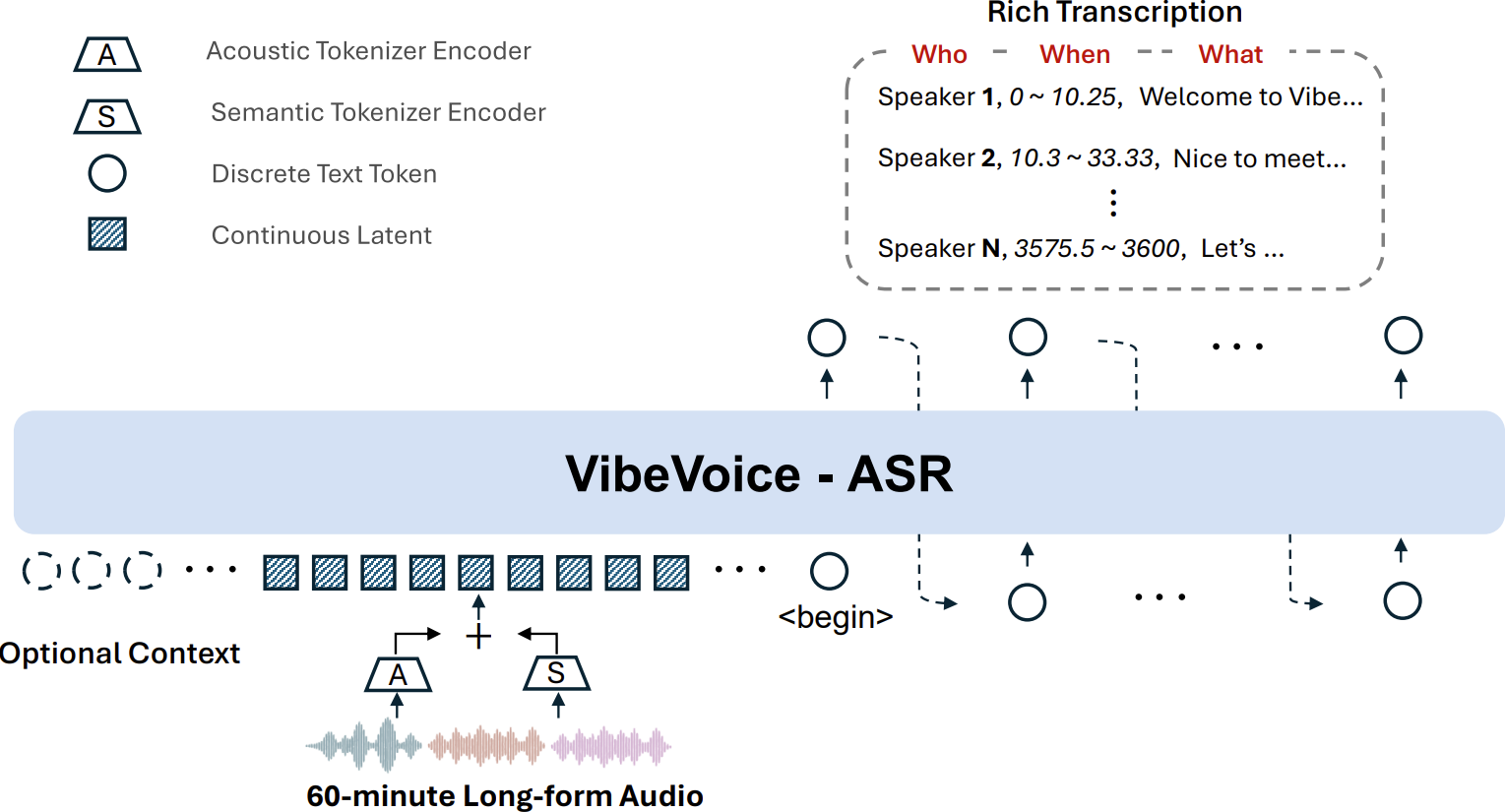

바로 VibeVoice-ASR이라는 음성-텍스트 변환 모델이다.

오늘은 이 VibeVoice-ASR이 뭔지, 왜 주목할 만한지 정리해보려 한다.

VibeVoice-ASR

VibeVoice-ASR은 마이크로소프트가 2026년 1월 21일에 오픈소스로 공개한 자동 음성 인식(ASR) 모델이다. 쉽게 말해 음성 파일을 텍스트로 변환해 주는 AI인데, 기존 모델들과는 좀 다른 특징이 있다.

가장 눈에 띄는 건 60분짜리 음성을 통째로 한번에 처리할 수 있다는 점이다. 보통 ASR 모델들은 긴 음성을 짧게 잘라서 처리하는데, 이 녀석은 한 시간짜리를 그냥 한방에 받아서 처리한다.

VibeVoice-ASR은 단순히 음성을 텍스트로 변환하는 것뿐만 아니라 , 세 가지 정보를 한꺼번에 제공한다.

- Who (누가): 화자 식별 - 누가 말했는지 구분

- When (언제): 타임스탬프 - 몇 분 몇 초에 말했는지

- What (무엇을): 실제 발화 내용 텍스트

즉, 회의 녹음 파일을 넣으면 "A씨가 3분 20초에 '이 프로젝트는 내일까지 완료해야 합니다'라고 말했다" 이런 식으로 구조화된 결과를 받을 수 있다는 것이다.

Features

1. 60-minute Single-Pass Processing

최근에 나오는 ASR 모델들을 보면, 짧게 짧게 끊어서 전사하는 경우가 많이 보였다.

나도 사실 어차피 음성을 텍스트로변환하기만 하면 되니까, 정확하기만 한다면 뭐 짧게 여려 번하던 길게 한 번에 하던 상관없다고 생각했다.

그러나 짧게짧게 변환하면 아래와 같은 문제가 발생한다.

- 화자 추적 일관성 문제: 앞 구간에서 "화자 1"로 인식됐던 사람이 뒷 구간에서 "화자 3"으로 바뀌는 일이 발생

- 맥락 손실: 대화 흐름이 끊겨서 문맥 이해가 어려움

- 처리 파이프라인 복잡도: ASR → 화자 분리 → 타임스탬프를 각각 돌려야 함

이를 VibeVOice-ASR은 64K 토큰 길이로 최대 60분을 한번에 받는다. 그래서:

- 한 시간 내내 같은 사람을 일관되게 추적 가능

- 전체 대화의 맥락을 유지하면서 인식

- ASR + 화자분리 + 타임스탬프를 하나의 모델에서 동시에 처리

쉽게 말해 "전체 그림을 보면서 처리한다"는 것이다.

2-1. Customized Hotwords:

이게 실무적으로 진짜 유용할 것 같은데, 도메인 특화 단어를 미리 알려줄 수 있다.

예를 들어:

- 기업 회의: 프로젝트 이름, 임직원 이름

- 의료: 질병명, 약물명

- 법률: 전문 용어

이런 걸 "핫워드"로 등록하면 인식 정확도가 크게 올라간다고 한다. 일반 모델은 "갤럭시폴드"를 "갤럭시 폴트"로 잘못 인식할 수 있지만, 핫워드로 등록하면 정확하게 인식하는 식이다.

2-2. Multilingual & Code-Switching Support

다국어를 지원하는데, 여기서 재미있는 건 언어 설정을 따로 안 해도 된다는 것이다. 자동으로 감지한다.

더 신기한 건 코드 스위칭(Code-Switching) 지원이다.

이런 식으로 한국어-영어가 섞인 발화도 자연스럽게 인식한다. 실제로 우리가 말할 때 이렇게 섞어 쓰는 경우가 많으니 실용적이다.

가장 좋았던 것은 한국어를 지원하는 모델이라는 것이다 ㅜㅜ 감사합니다.

3. 모델 스펙

| 항목 | 내용 |

|---|---|

| 파라미터 수 | 9B (90억개) |

| 데이터 타입 | BF16 (Bfloat16) |

| 포맷 | Safetensors |

| 라이선스 | MIT |

| 프레임워크 | Transformers |

MIT 라이선스라는 게 포인트다. 상업적으로도 자유롭게 사용 가능하다는 뜻이다.

논문도 공개되어 있다: arXiv:2601.18184

4. 성능

모델 평가에는 세 가지 지표를 사용한다고 한다:

- DER (Diarization Error Rate): 화자 분리 오류율

- cpWER (Character Piece Word Error Rate): 단어 인식 오류율

- tcpWER (Time-aware cpWER): 시간 정보 고려한 오류율

정확한 수치 논문과 HuggingFace 페이지에 그래프로 나와있는데, gemini2.5 pro, gemini 3.0 pro와 비교하여 우수한 성능을 보였다

마무리

VibeVoice-ASR을 정리하면:

- ✅ 60분 통째로 한방에 처리 (ASR + 화자분리 + 타임스탬프 통합)

- ✅ 커스텀 핫워드로 도메인 특화 가능

- ✅ 50개 언어 + 코드 스위칭 지원

- ✅ MIT 라이선스로 상업적 사용 가능

- ⚠️ 실시간보다는 배치 처리에 적합

개인적으로는 회의 녹음 자동 정리용으로 진짜 유용할 것 같다. 특히 화자별로 발화 내용이 구분되는 건 엄청 편리할 듯하다.

다만 9B 모델이라 로컬에서 돌리려면 GPU가 필요하니, 간단한 테스트는 데모 페이지에서 해보고, 본격적으로 쓸 거면 클라우드 GPU 환경을 고려하는 게 좋겠다.

아무튼 마이크로소프트가 이런 고품질 모델을 오픈소스로 공개해 줘서 고맙다!! 나중에 실제 프로젝트에 적용해 보면 또 후기를 작성해 볼 예정이다.

허깅페이스에 데모도 공개되어있으니 실험해 보면 좋을 것 같다.

또한 Microsoft에서 작성한 파인튜닝 가이드도 존재하며, vllm으로 서빙도 가능해서 실무등에서 바로 활용해 볼 수 있을 것 같다.

- 가이드: Finetuning README

- 문서: vLLM-VibeVoice-ASR

Gradio

Click to try out the app!

dfd7cdd77aee79cc37.gradio.live

참고 자료

'알쓸신잡' 카테고리의 다른 글

| Claudian-옵시디언에서 Claude Code 사용하기 (0) | 2026.02.04 |

|---|---|

| Daggr - HuggingFace의 새로운 AI 워크플로우 도구 (0) | 2026.02.02 |

| PaddleOCR-VL-1.5-초경량 OCR의 새로운 강자 (0) | 2026.02.02 |

| STAX - 구글이 내놓은 LLM 평가 플랫폼 (0) | 2026.01.26 |

| Google TranslateGemma - 55개 언어 번역 모델과 EOS 이슈 해결 (0) | 2026.01.22 |